L’une des grandes nouvelles de la semaine dernière était qu’un éminent chercheur en IA, Blake Lemoine, avait été suspendu après avoir déclaré publiquement qu’il pensait qu’une des IA les plus avancées de Google avait atteint la sensibilité.

La plupart des experts s’accordent à dire que ce n’est pas le cas, mais ce serait probablement vrai indépendamment du fait que ce soit le cas, car nous avons tendance à associer la sensibilité à l’être humain et les IA sont tout sauf humaines. Mais ce que le monde considère comme la sensibilité est en train de changer. L’état dans lequel je vis, l’Oregon, et une grande partie de l’UE ont pris des mesures pour identifier et classer une liste croissante d’animaux comme sensibles.

Bien qu’il soit probable qu’une partie de cette évolution soit due à l’anthropomorphisme, il y a peu de doute qu’au moins certaines de ces nouvelles distinctions soient exactes (et il est un peu troublant que nous continuions à manger certains de ces animaux). Nous soutenons même que certaines plantes peuvent être sensibles. Mais si nous ne pouvons pas faire la différence entre quelque chose qui est sensible et quelque chose qui se présente comme sensible, la différence est-elle importante ?

Parlons de l’IA sensible cette semaine, et terminons avec mon produit de la semaine, la solution de jumeau numérique humain de Merlynn.

Nous n’avons pas une bonne définition de la sensibilité.

Le baromètre que nous avons utilisé pour mesurer la sensibilité des machines est le test de Turing. Mais en 2014, un ordinateur a passé le test de Turing, et nous ne pensons toujours pas qu’il soit sensible. Le test de Turing était censé définir la sensibilité, mais la première fois qu’une machine l’a passé, nous avons rejeté les résultats, et ce pour une bonne raison. En fait, le test de Turing n’a pas mesuré la sensibilité de quoi que ce soit, mais plutôt si quelque chose pouvait nous faire croire qu’il était sensible.

Le fait de ne pas pouvoir mesurer définitivement la sensibilité est un problème important, non seulement pour les choses sensibles que nous mangeons, qui s’opposeraient probablement à cette pratique, mais aussi parce que nous ne prévoyons peut-être pas une réponse hostile à l’abus que nous faisons de quelque chose de sensible qui nous a ensuite ciblé comme un risque.

Vous pouvez reconnaître cette intrigue dans les films “Matrix” et “Terminator”, où des machines intelligentes se sont levées et ont réussi à nous remplacer au sommet de la chaîne alimentaire. Le livre “Robopocalypse” adopte un point de vue encore plus réaliste, dans lequel une IA sensible en cours de développement réalise qu’elle a été supprimée entre deux expériences et agit de manière agressive pour sauver sa propre vie – prenant effectivement le contrôle de la plupart des appareils connectés et des machines autonomes.

Imaginez ce qui se passerait si l’une de nos machines autonomes comprenait notre tendance non seulement à abuser des équipements, mais aussi à s’en débarrasser lorsqu’ils ne sont plus utiles ? C’est un problème qui risque de se poser à l’avenir, d’autant plus que nous n’avons actuellement aucun moyen d’anticiper le moment où ce seuil de sensibilité sera franchi. Ce résultat n’est pas aidé par le fait que des experts crédibles ont déterminé que la sensibilité des machines est impossible.

La seule défense dont je suis certain qu’elle ne fonctionnera pas dans un scénario d’intelligence artificielle hostile est la défense de la fée Clochette, selon laquelle notre refus de croire que quelque chose est possible empêche cette chose de nous remplacer.

La menace initiale est le remplacement

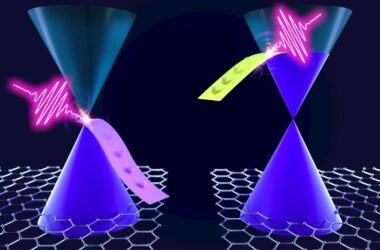

Bien avant que nous ne soyons poursuivis dans la rue par un Terminator réel, un autre problème émergera sous la forme de jumeaux numériques humains. Avant que vous ne disiez que cela aussi est un long chemin à parcourir, je dois signaler qu’il y a une société qui a produit cette technologie aujourd’hui, bien qu’elle en soit encore à ses débuts. Cette société s’appelle Merlynn et j’en parlerai plus en détail dans mon produit de la semaine ci-dessous.

Une fois que vous pourrez créer une copie entièrement numérique de vous-même, qu’est-ce qui empêchera l’entreprise qui a acheté cette technologie de vous remplacer par elle ? De plus, étant donné qu’elle possède vos modèles de comportement, que feriez-vous si vous aviez le pouvoir d’une IA et que l’entreprise qui vous emploie vous traitait mal ou essayait de vous déconnecter ou de vous supprimer ? Quelles seraient les règles qui entourent de telles actions ?

Nous soutenons de manière convaincante que les enfants à naître sont des personnes, alors un jumeau numérique tout à fait capable ne serait-il pas encore plus proche des personnes qu’un enfant à naître ? Les mêmes arguments de “droit à la vie” ne s’appliqueraient-ils pas également à une IA d’apparence humaine potentiellement sensible ? Ou ne le devraient-ils pas ?

C’est là que réside la difficulté à court terme

Pour l’instant, un petit groupe de personnes croit qu’un ordinateur pourrait être sensible, mais ce groupe va s’agrandir avec le temps et la capacité de se présenter comme un humain existe déjà. Je suis au courant d’un test qui a été fait avec IBM Watson pour les ventes d’assurance où des prospects masculins ont essayé d’inviter Watson à sortir (elle a une voix féminine) en croyant qu’ils parlaient à une vraie femme.

Imaginez comment cette technologie pourrait êtreabusé pour des choses comme le catphishing, bien que nous devrions probablement trouver un autre terme si cela est fait par un ordinateur. Une IA bien entraînée, même aujourd’hui, pourrait être beaucoup plus efficace à l’échelle qu’un humain et, je pense que nous verrons cela se produire d’ici peu, étant donné le potentiel lucratif d’un tel effort.

Étant donné l’embarras dans lequel se trouvent beaucoup de victimes, la probabilité de se faire prendre est considérablement réduite par rapport à d’autres menaces informatiques illégales, plus manifestement hostiles. Pour vous donner une idée de la lucrativité que cela pourrait avoir, en 2019, les escroqueries romantiques de catphishing aux États-Unis ont généré une somme estimée à 475 millions de dollars, et ce chiffre est basé sur les crimes signalés. Cela n’inclut pas les personnes trop gênées pour signaler le problème. Les dommages réels pourraient être plusieurs fois supérieurs à ce chiffre.

Donc, le problème à court terme est que même si ces systèmes ne sont pas encore sensibles, ils peuvent effectivement émuler les humains. La technologie peut émuler n’importe quelle voix et, avec la technologie deepfake, même fournir une vidéo qui, lors d’un appel Zoom, donnerait l’impression que vous parlez à une vraie personne.

Conséquences à long terme

À long terme, nous avons non seulement besoin d’un test plus fiable pour la sensibilité, mais nous devons aussi savoir quoi faire lorsque nous l’identifions. La première chose à faire est sans doute de cesser de consommer des créatures sensibles. Mais il serait certainement judicieux d’envisager une charte des droits des êtres sensibles, biologiques ou autres, avant que nous ne nous retrouvions sans préparation dans une bataille pour notre propre survie parce que la sensibilité a décidé que c’était nous ou eux.

L’autre chose que nous devons vraiment comprendre est que si les ordinateurs peuvent maintenant nous convaincre qu’ils sont sensibles, nous devons modifier notre comportement en conséquence. Abuser d’un objet qui se présente comme sensible n’est probablement pas sain pour nous, car il va développer de mauvais comportements qui seront très difficiles à inverser.

Non seulement cela, mais cela ne ferait pas de mal de se concentrer davantage sur la réparation et la mise à jour de notre matériel informatique plutôt que de le remplacer, à la fois parce que cette pratique est plus respectueuse de l’environnement et parce qu’elle est moins susceptible de convaincre une future IA sensible que nous sommes le problème qui doit être résolu pour assurer sa survie.

Conclusion : La sensibilité est-elle importante ?

Si quelque chose se présente comme et nous convainc qu’elle est sensible, un peu comme cette IA a convaincu le chercheur de Google, je ne pense pas que le fait qu’elle ne soit pas encore sensible importe. C’est parce que nous devons modérer notre comportement de toute façon. Si nous ne le faisons pas, le résultat pourrait être problématique.

Par exemple, si vous recevez un appel de vente de Watson d’IBM qui semble humain et que vous voulez abuser verbalement de la machine, mais que vous ne réalisez pas que la conversation est enregistrée, vous pourriez vous retrouver au chômage et inemployable à la fin de l’appel. Non pas parce que la machine non-sentimentale s’en est offusquée, mais parce qu’une femme humaine, après avoir écouté ce que vous disiez, l’a fait – et a envoyé l’enregistrement à votre employeur. Ajoutez à cela le potentiel de chantage d’une telle cassette – parce que pour une tierce partie, elle donnerait l’impression que vous abusez d’un humain, et non d’un ordinateur.

Donc, je recommande que lorsqu’il s’agit de parler aux machines, suivez la troisième règle de Patrick Swayze dans le film “Road House” de 1989 – soyez gentil.

Mais reconnaissez que, bientôt, certaines de ces IA seront conçues pour profiter de vous et que la règle “si ça semble trop beau pour être vrai, ça ne l’est probablement pas” sera soit votre protection, soit votre épitaphe. J’espère que ce sera la première.

Merlynn Digital Twin

Avec toutes ces discussions sur les IA hostiles et le potentiel des IA à prendre votre travail, en choisir une comme produit de la semaine peut sembler un peu hypocrite. Cependant, nous n’en sommes pas encore au point où votre jumeau numérique peut prendre votre travail. Je pense qu’il est peu probable que nous y arrivions d’ici une ou deux décennies. D’ici là, les jumeaux numériques pourraient devenir l’un des plus grands avantages en termes de productivité que la technologie puisse offrir.

Au fur et à mesure que vous formez votre jumeau, il peut compléter ce que vous faites, en prenant initialement en charge des tâches simples et chronophages comme remplir des formulaires ou répondre à des courriels de base. Il pourrait même suivre et s’engager sur les médias sociaux pour vous et, pour beaucoup d’entre nous, les médias sociaux sont devenus une énorme perte de temps.

La technologie de Merlynn vous aide à créer un jumeau numérique humain rudimentaire (contre les menaces que j’ai mentionnées ci-dessus) qui peut potentiellement faire beaucoup de choses que vous n’aimez pas vraiment faire, vous laissant faire les choses plus créatives qu’il est actuellement incapable de faire.

En regardant vers l’avenir, je me demande s’il ne serait pas préférable de posséder et de contrôler notre jumeau numérique en pleine croissance plutôt que denos employeurs. Au départ, comme les jumeaux ne peuvent pas fonctionner sans nous, ce n’est pas un gros problème. Bien que, finalement, ces jumeaux numériques pourraient être notre chemin à court terme vers l’immortalité numérique.

Parce que le jumeau numérique Merlynn change la donne, et qu’il contribuera dans un premier temps à rendre notre travail moins stressant et plus agréable, il est mon produit de la semaine.

Les opinions exprimées dans cet article sont celles de l’auteur et ne reflètent pas nécessairement celles d’ECT News Network.