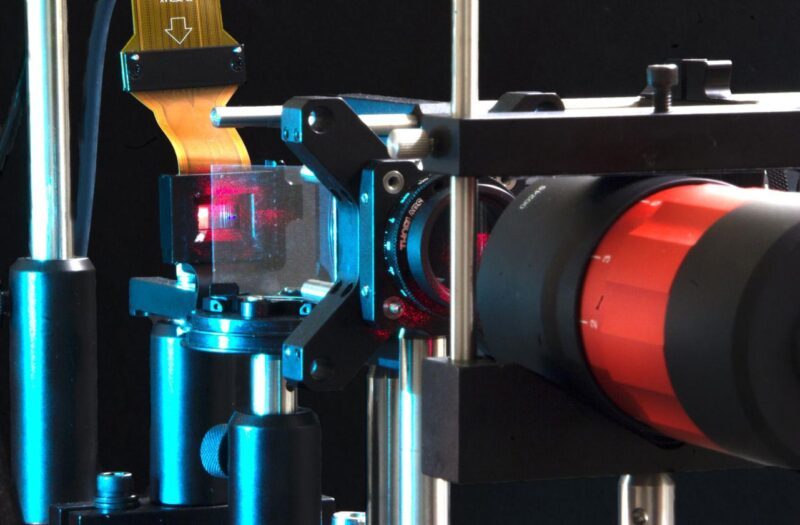

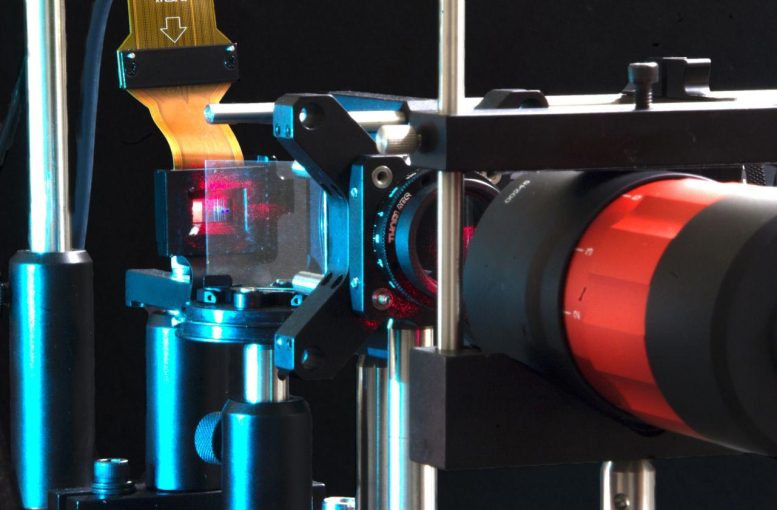

Photographie d’un prototype d’affichage holographique. Crédit: Stanford Computational Imaging Lab

Les casques de réalité virtuelle et augmentée sont conçus pour placer les utilisateurs directement dans d’autres environnements, mondes et expériences. Alors que la technologie est déjà populaire parmi les consommateurs pour sa qualité immersive, il pourrait y avoir un avenir où les écrans holographiques ressemblent encore plus à la vraie vie. Dans sa propre quête de ces meilleurs affichages, le Stanford Computational Imaging Lab a combiné son expertise en optique et en intelligence artificielle. Leurs avancées les plus récentes dans ce domaine sont détaillées dans un article publié aujourd’hui (12 novembre 2021) dans Avancées scientifiques et des travaux qui seront présentés au SIGGRAPH ASIA 2021 en décembre.

À la base, cette recherche confronte le fait que les écrans actuels de réalité augmentée et virtuelle ne montrent que des images 2D à chacun des yeux du spectateur, au lieu d’images 3D – ou holographiques – comme nous le voyons dans le monde réel.

“Ils ne sont pas réalistes sur le plan de la perception”, a expliqué Gordon Wetzstein, professeur agrégé de génie électrique et chef du Stanford Computational Imaging Lab. Wetzstein et ses collègues travaillent à trouver des solutions pour combler ce fossé entre la simulation et la réalité tout en créant des affichages plus attrayants visuellement et plus agréables pour les yeux.

La recherche publiée dans Avancées scientifiques détaille une technique pour réduire une distorsion mouchetée souvent observée dans les écrans holographiques à base de laser réguliers, tandis que l’article SIGGRAPH Asia propose une technique pour représenter de manière plus réaliste la physique qui s’appliquerait à la scène 3D si elle existait dans le monde réel.

Faire le pont entre la simulation et la réalité

Au cours des dernières décennies, la qualité d’image des écrans holographiques existants a été limitée. Comme l’explique Wetzstein, les chercheurs ont été confrontés au défi d’obtenir un écran holographique aussi beau qu’un écran LCD.

Un problème est qu’il est difficile de contrôler la forme des ondes lumineuses à la résolution d’un hologramme. L’autre défi majeur qui entrave la création d’écrans holographiques de haute qualité est de combler l’écart entre ce qui se passe dans la simulation et ce à quoi ressemblerait la même scène dans un environnement réel.

Auparavant, les scientifiques ont tenté de créer des algorithmes pour résoudre ces deux problèmes. Wetzstein et ses collègues ont également développé des algorithmes, mais l’ont fait en utilisant des réseaux de neurones, une forme d’intelligence artificielle qui tente d’imiter la façon dont le cerveau humain apprend des informations. Ils appellent ça “holographie neuronale. “

“L’intelligence artificielle a révolutionné à peu près tous les aspects de l’ingénierie et au-delà”, a déclaré Wetzstein. “Mais dans ce domaine spécifique des écrans holographiques ou de l’holographie générée par ordinateur, les gens viennent tout juste de commencer à explorer les techniques d’IA.”

Yifan Peng, chercheur postdoctoral au Stanford Computational Imaging Lab, utilise son expérience interdisciplinaire en optique et en informatique pour aider à concevoir le moteur optique destiné aux écrans holographiques.

“Ce n’est que récemment, avec les innovations émergentes en matière d’intelligence artificielle, que nous avons eu accès à des outils et à des capacités puissants pour tirer parti des progrès de la technologie informatique”, a déclaré Peng, co-auteur principal du Avancées scientifiques papier et co-auteur de l’article SIGGRAPH.

Les affichage holographique neuronal que ces chercheurs ont créé impliquait la formation d’un réseau de neurones pour imiter la physique du monde réel de ce qui se passait à l’écran et obtenir des images en temps réel. Ils ont ensuite associé cela à une stratégie d’étalonnage « caméra dans la boucle » qui fournit un retour quasi instantané pour informer les ajustements et les améliorations. En créant un algorithme et une technique d’étalonnage, qui fonctionnent en temps réel avec l’image vue, les chercheurs ont pu créer des visuels plus réalistes avec une meilleure couleur, un meilleur contraste et une meilleure clarté.

Le nouveau document SIGGRAPH Asia met en lumière la première application du laboratoire de leur système d’holographie neuronale aux scènes 3D. Ce système produit une représentation réaliste et de haute qualité des scènes qui contiennent une profondeur visuelle, même lorsque des parties des scènes sont intentionnellement représentées comme éloignées ou floues.

Les Avancées scientifiques Le travail utilise la même stratégie d’optimisation de caméra dans la boucle, associée à un algorithme inspiré de l’intelligence artificielle, pour fournir un système amélioré pour les écrans holographiques qui utilisent des sources de lumière partiellement cohérentes – LED et SLED. Ces sources lumineuses sont attrayantes pour leur coût, leur taille et leurs besoins énergétiques et elles ont également le potentiel d’éviter l’apparence tachetée des images produites par des systèmes qui reposent sur des sources lumineuses cohérentes, comme les lasers. Mais les mêmes caractéristiques qui aident les systèmes sources partiellement cohérents à éviter les taches ont tendance à produire des images floues avec un manque de contraste. En construisant un algorithme spécifique à la physique des sources lumineuses partiellement cohérentes, les chercheurs ont produit les premières images holographiques 2D et 3D de haute qualité et sans tache à l’aide de LED et de SLED.

Potentiel de transformation

Wetzstein et Peng pensent que ce couplage des techniques émergentes d’intelligence artificielle avec la réalité virtuelle et augmentée deviendra de plus en plus omniprésent dans un certain nombre d’industries dans les années à venir.

“Je crois fermement en l’avenir des systèmes informatiques portables et de la RA et de la VR en général, je pense qu’ils vont avoir un impact transformateur sur la vie des gens”, a déclaré Wetzstein. Ce ne sera peut-être pas dans les prochaines années, a-t-il déclaré, mais Wetzstein pense que la réalité augmentée est le «grand avenir».

Bien que la réalité virtuelle augmentée soit principalement associée au jeu en ce moment, celle-ci et la réalité augmentée ont une utilisation potentielle dans divers domaines, y compris la médecine. Les étudiants en médecine peuvent utiliser la réalité augmentée pour la formation ainsi que pour superposer les données médicales des tomodensitogrammes et des IRM directement sur les patients.

“Ces types de technologies sont déjà utilisés pour des milliers de chirurgies par an”, a déclaré Wetzstein. « Nous envisageons que les écrans portés sur la tête qui sont plus petits, plus légers et simplement plus confortables visuellement sont une grande partie de l’avenir de la planification de la chirurgie. »

“C’est très excitant de voir comment le calcul peut améliorer la qualité d’affichage avec la même configuration matérielle”, a déclaré Jonghyun Kim, chercheur invité de Nvidia et co-auteur des deux articles. “Un meilleur calcul peut créer un meilleur affichage, ce qui peut changer la donne pour l’industrie de l’affichage.”

Référence : « Holographie sans speckle avec des sources lumineuses partiellement cohérentes et un étalonnage de caméra dans la boucle » par Yifan Peng, Suyeon Choi, Jonghyun Kim et Gordon Wetzstein, 12 novembre 2021, Avancées scientifiques.

DOI : 10.1126 / sciadv.abg5040

L’étudiant diplômé de Stanford est co-auteur principal des deux articles Suyeon Choi et l’étudiant diplômé de Stanford Manu Gopakumar est co-auteur principal de l’article SIGGRAPH. Ce travail a été financé par Ford, Sony, Intel, la National Science Foundation, le Army Research Office, une bourse Kwanjeong, une bourse du gouvernement coréen et une bourse d’études supérieures Stanford.